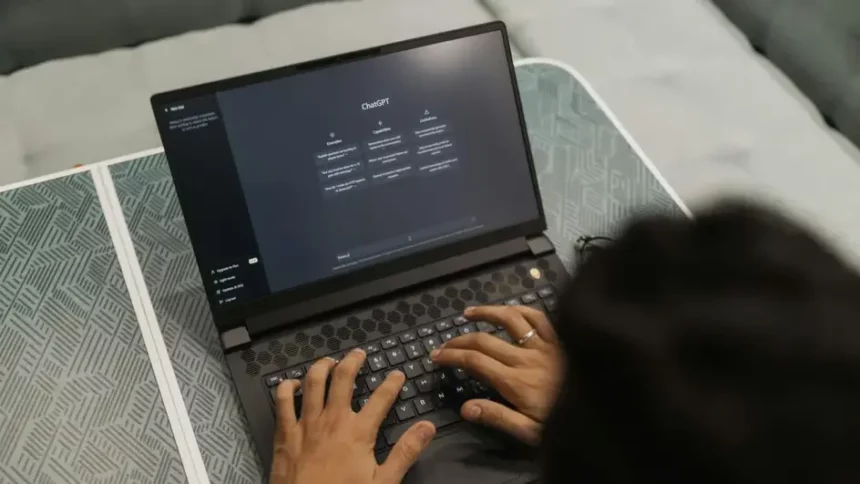

Vještačka inteligencija je sve više prisutna u našim životima i svakim danom se sve više koristi, a popularnost AI četbot aplikacija, kakve su ČetGPT i Gugl Gemini, stalno raste.

Ovi četbot-ovi ljudima su privlačni zbog svoje sposobnosti da, na postavljena pitanja, generišu odgovore veoma bliske ljudskoj komunikaciji.

Međutim, njihovo oslanjanje na velike jezične modele (LLM) nije bez rizika, pa je važno razumijeti da neke podatke i informacije nikada ne bi trebalo djeliti sa AI četbot-ovima.

Naime, lični podaci korisnika podijeljni sa AI četbot-ovima mogu biti otkriveni i zloupotrijebljeni, prije svega, zbog toga što se mogu se naći među podacima koji se koriste za treniranje drugih AI botova. Do njih tada mogu da dođu i kod kompanije koji stoje iz ovih AI alata i njihovih partnera, kao i hakeri, ako provale u sistem.

Zato, ovih 5 vrsta podataka nikada ne bi trebalo da djelite sa vještačkom inteligencijom:

Podaci o finansijama

Ako AI četbot-ove koristite kao lične finansijske savjetnike, rizikujete da informacije o svojim finansijama izložite sajber kriminalcima koji bi to mogli da iskoriste da isprazne vaše račune ili da ih zloupotrebe za druge vrste prevara.

Uprkos tome što kompanije često tvrde da su podaci iz konverzacije korisnika i AI-ja anonimni, neki zaposleni u tim kompanijama ili njihovi partneri treće strane bi i dalje mogli da imaju pristup njima.

Četbot bi, na primjer, mogao da analizira potrošačke navike korisnika da bi mu ponudio savjete, ali ako tim podacima neko pristupi neovlašćeno, oni bi mogli biti zloupotrebljeni da onoga čiji su profilišu kao prevaranta, npr. da budu iskorišćeni za phishing imejlove koje imitiraju vašu banku.

Šifre

Dijeljenje lozinki različitih naloga na internetu je generalno rizično, na šta stručnjaci za sajber bezbjednost stalno upozoravaju. Isto važi i za velike jezične modele na kojima se AI chatbot-ovi zasnovani, pa se takvim potezom izlažete velikim rizicima.

Zato, da biste se zaštitili, šifre svojih onlajn naloga nikada ne djelite sa četbot-ovima, čak ni kada bi to moglo da bude u svrhu rješavanja nekog problema.

Povjerljive informacije o radnom mjestu

Tehnološki giganti Epl, Samsung i Gugl svojim zaposlenima su ograničili upotrebu AI četbot-ova na radnom mjestu, nakon što su te kompanije primjetile slučajeve nenamjernog objavljivanja osjetljivih informacija u komunikaciji sa vještačkom inteligencijom.

Tako je jedan programer u Samsungu koristio ČetGPT kao pomoć u kodiranju i time nehotice podijelio osjetljiv kod sa generativnim AI-jem. Mnogi zaposleni se oslanjaju na četbot-ove da bi sumirali zaključke poslovnih sastanaka ili automatizuju repetitivne zadatke koji se ponavljaju, ali time ulaze u rizik od izlaganja osjetljivih podataka.

Zbog svega toga, veoma je važno voditi računa o rizicima vezanim za dijeljenje podataka u vezani sa poslom, ističe MakeUseOf.

Adresa i drugi lični podaci

Osjetljivi lični podaci kao što su adresa i mjesto stanovanja, datum rođenja, matični broj ili podaci o zdravlju, mogu biti iskorišćeni za identifikaciju i lociranje njihovog vlasnika, pa ih je zato potrebno zadržati za sebe uvijek kada je to moguće.

Zato je potrebno upoznati se sa pravilima privatnosti četbot-a da bi se razumjeli rizici. Zato izbjegavajte postavljanje pitanja koja nenamjerno mogu da otkriju identitet i/ili lične podatke. Budite posebno oprezni i uzdržite se od dijeljenja medicinskih podataka.

Lično stanje i intimne misli

AI četbot-ovi možda mogu da budu dobri sagovornici, ali im nedostaje znanje o stvarnom svijetu, zato na npr. pitanja o (mentalnom) zdravlju mogu da ponude samo generičke odgovore.

To znači da lijekovi ili tretmani koje predlažu možda nisu adekvatni za specifične potrebe korisnika i da mogu da budu štetni po zdravlje.

o takođe važi i za upozorenja u vezi sa zaštitom privatnosti. Ako se neko zlonamjeran dokopa vaših intimnih misli, vaša privatnost može biti kompromitovana, a intimne misli iskorišćene kao podaci za treniranje vještačke inteligencije.

Zbog svega toga AI četbot-ove treba koristiti za razmjenu opštih informacija i znanja, i od njih ne očekivati profesionalnu podršku ili terapiju, piše Glas Srpske.